Главная страница Случайная страница

Разделы сайта

АвтомобилиАстрономияБиологияГеографияДом и садДругие языкиДругоеИнформатикаИсторияКультураЛитератураЛогикаМатематикаМедицинаМеталлургияМеханикаОбразованиеОхрана трудаПедагогикаПолитикаПравоПсихологияРелигияРиторикаСоциологияСпортСтроительствоТехнологияТуризмФизикаФилософияФинансыХимияЧерчениеЭкологияЭкономикаЭлектроника

Алгоритм зворотного розповсюдження помилки для навчання нейтронної мережі

|

|

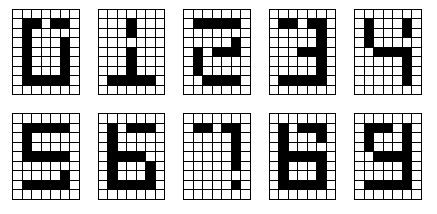

Суть алгоритму зводиться до послідовного подання на вхід мережі еталонних значень (рис.3), визначення вихідного вектору мережі (прямий прохід), і корегування коефіцієнтів ваги для зв’язків нейронів на основі визначення різниці між еталонним значенням вихідного вектору та отриманим (зворотній прохід). Корегування відбувається на основі норми навчання  та коефіцієнта інерції

та коефіцієнта інерції  . Навчання мережі припиняється при досягненні збіжності між еталонним та отриманим значенням вихідного вектора для всіх еталонних прикладів.

. Навчання мережі припиняється при досягненні збіжності між еталонним та отриманим значенням вихідного вектора для всіх еталонних прикладів.

При реалізації алгоритму норму навчання обрати на рівні 0.3, а коефіцієнт інерції 0.7. Значення кожного біту вихідного вектора визначати за формулою:

Послідовність кроків алгоритму:

- Прочитати перший вхідний зразок(еталон) і встановити вихідний зразок, що йому відповідає; Converge = TRUE.

- Задати значення для кожного з вхідних нейронів значення вхідного зразка.

- Для елементів першого прихованого шару обчислити сумарний вхід та вихід

,

,

- Повторити крок 3 для всіх наступних прихованих шарів та вихідного шару нейронів.

- Якщо різниця між значенням виходу мережі і вихідним зразком не є допустимою, Converge = Converge& FALSE.

- Для кожного вихідного елементу визначити його помилку

- Для останнього прихованого шару визначити помилку кожного елемента

- Повторити крок 7 для всіх інших шарів

- Для всіх шарів перерахувати значення ваг кожного елемента

,

,

- Якщо вхідний зразок був не останнім, прочитати наступний і перейти до кроку 2.

- Якщо Converge == FALSE, перейти до кроку 1.

- Кінець

Перелік позначень:

i, j, k – індекси;

-i-ий вхідний сигнал нейрону;

-i-ий вхідний сигнал нейрону;

- ваговий коефіцієнт з’єднання i-го та j-го нейронів;

- ваговий коефіцієнт з’єднання i-го та j-го нейронів;

- сумарне вхідне значення нейрону j;

- сумарне вхідне значення нейрону j;

- вихідне значення нейрону j;

- вихідне значення нейрону j;

- функція активації;

- функція активації;

- значення помилки для j-го нейрону;

- значення помилки для j-го нейрону;

- еталонне значення j-го нейрону зовнішнього шару;

- еталонне значення j-го нейрону зовнішнього шару;

- помилка для вагового коефіцієнта зв’язку між нейронами i та j на n кроці обчислень

- помилка для вагового коефіцієнта зв’язку між нейронами i та j на n кроці обчислень

- норма навчання;

- норма навчання;

- коефіцієнт інерції;

- коефіцієнт інерції;

Converge – ознака припинення навчання.

Рис.4. Приклади для тестування нейронної мережі

В звіті представити:

- Завдання: розпізнати символи, які складають прізвища студента.

- Теоретичні відомості

- Результати навчання

- Результати розпізнавання

- Текст програми

- Висновки

|

|