Главная страница Случайная страница

Разделы сайта

АвтомобилиАстрономияБиологияГеографияДом и садДругие языкиДругоеИнформатикаИсторияКультураЛитератураЛогикаМатематикаМедицинаМеталлургияМеханикаОбразованиеОхрана трудаПедагогикаПолитикаПравоПсихологияРелигияРиторикаСоциологияСпортСтроительствоТехнологияТуризмФизикаФилософияФинансыХимияЧерчениеЭкологияЭкономикаЭлектроника

Використання методу зворотного розповсюдження помилки для навчання нейронної мережі.

|

|

Курсова робота

Мета роботи:

Вивчити основні принципи функціонування нейронних мереж, реалізувати алгоритм зворотного розповсюдження помилки для навчання мережі, дослідити можливості застосування нейронних мереж для вирішення задач теорії штучного інтелекту.

Завдання:

Скласти програму, яка реалізує функціонування нейронної мережі (рис.1) для задачі розпізнавання (класифікації) чисел. Представити операцію навчання мережі на прикладах для навчання (рис.3). Протестувати програму для контрольних прикладів (рис.4).

Передбачити для користувача можливість зміни:

1) початкового діапазону розподілу ваги для зв’язків нейронної мережі A[a1, a2];

2) кількості прихованих шарів нейронної мережі t;

3) кількості нейронів кожного прихованого шару qt, i=[1..t];

4) коефіцієнту навчання  ;

;

5) коефіцієнту інерції  .

.

Дослідити вплив вище перелічених параметрів на швидкість навчання мережі та якість розпізнавання образів.

Теоретичні відомості:

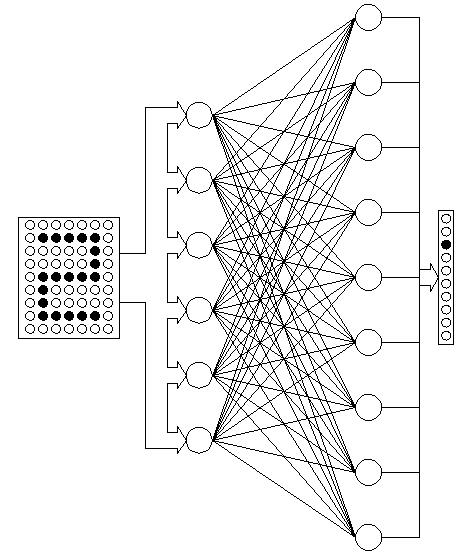

Задача полягає у розпізнаванні (класифікації) числа, яке представлене бітовою матрицею розміру 9х7. Вихідний вектор мережі має містити інформацію про належність числа до одного з 10 класів (числа від 0 до 9). Наприклад, якщо на вхід мережі буде подано матрицю, що відповідає числу 2, то у вихідному векторі значення другого біту буде дорівнювати 1. Для вирішення задачі обрати нейронну мережу з 63 вхідними нейронами, 6 нейронами прихованого шару і 10 вихідними нейронами (рис.1). Нейрони прихованого шару поєднані з усіма вхідними нейронами, а зовнішнього шару – з усіма нейронами прихованого.

Рис.1. Загальний вигляд нейронної мережі.

Відповідність пікселів матриці нейронам вхідного шару наведена на рис.2.

Рис.2. Відповідність пікселів нейронам вхідного шару

Числа для навчання нейронної мережі показано на рис.3.

Рис.3. Числа для навчання нейронної мережі.

— Регулярная проверка качества ссылок по более чем 100 показателям и ежедневный пересчет показателей качества проекта.

— Все известные форматы ссылок: арендные ссылки, вечные ссылки, публикации (упоминания, мнения, отзывы, статьи, пресс-релизы).

— SeoHammer покажет, где рост или падение, а также запросы, на которые нужно обратить внимание.

SeoHammer еще предоставляет технологию Буст, она ускоряет продвижение в десятки раз, а первые результаты появляются уже в течение первых 7 дней. Зарегистрироваться и Начать продвижение

|

|