Главная страница Случайная страница

Разделы сайта

АвтомобилиАстрономияБиологияГеографияДом и садДругие языкиДругоеИнформатикаИсторияКультураЛитератураЛогикаМатематикаМедицинаМеталлургияМеханикаОбразованиеОхрана трудаПедагогикаПолитикаПравоПсихологияРелигияРиторикаСоциологияСпортСтроительствоТехнологияТуризмФизикаФилософияФинансыХимияЧерчениеЭкологияЭкономикаЭлектроника

Основные понятия теории вероятности и математической статистики

|

|

ИСХОДНАЯ ИНФОРМАЦИЯ ДЛЯ МОДЕЛИРОВАНИЯ

В данном разделе освещаются вопросы, связанные со сбором исходной информации для моделирования и ее обработкой.

ВИДЫ ИНФОРМАЦИИ

Информация для моделирования носит разнообразный характер – детерминированная и случайная, нормативная и расчетная, достоверная и недостоверная, репрезентативная и нерепрезентативная, независимая от деятельности человека и зависимая (изменяющаяся), значимая (ценная) и незначимая, производственная и природная, экономическая и техническая и так далее. Каждый из перечисленных видов информации требует своих подходов для сбора и обработки. Проще всего оперировать с детерминированной технико – экономической информацией, отраженной в экономико – бухгалтерской отчетности предприятий. Это различные стоимостные показатели – себестоимость, прибыль, приведенные затраты и другие – на валке, обрезке сучьев, трелевке, погрузке, раскряжевке, то есть по операциям и в целом по всему циклу лесозаготовительного производства; временные показатели – коэффициент использования машин и рабочего времени – и прочие. Однако при сборе подобной информации следует обратить особое внимание на ее достоверность – правильность и адекватность представления реальности, – ибо готовят такую информацию люди, которым свойственны различные ошибки.

Наиболее трудоемок процесс получения информации, характеризующей предмет труда, природно – производственные условия, надежность работы механизмов, колебания их производительности, то есть информации случайного – стохастического или статистического – характера. Более подробно с основными понятиями случайной величины, законами ее распределений, конкретными описаниями отраслевой информации можно познакомиться в [3, 13, 26-31]. Последующие подразделы представляют способы получения достоверной стохастической информации для моделирования объектов лесозаготовок.

ОСНОВНЫЕ ПОНЯТИЯ ТЕОРИИ ВЕРОЯТНОСТИ И МАТЕМАТИЧЕСКОЙ СТАТИСТИКИ

Для дальнейшего правильного понимания сущности излагаемого материала рассмотрим некоторые понятия теории вероятностей и математической статистики, более подробно с которыми можно ознакомиться в [28— 30], а также в ГОСТ Р 50779.10-2000 (ИС03534.1-93) «Статистические методы. Вероятность и основы статистики. Термины и определения».

Ключевым понятием теории вероятностей является событие. События можно подразделить на три вида: достоверные, невозможные и случайные. Достоверным называют событие, которое обязательно произойдет, если будет иметь место определенная совокупность условий. Невозможным называют такое событие, которое при определенной совокупности условий не может произойти ни при каком повторении испытаний. Случайным называется всякое событие, которое в результате опыта при осуществлении определенной совокупности условий может произойти или не произойти. Случай – весьма загадочное явление внезапного появления или непоявления, не позволяющее проникнуть в сущность его самого. Однако физическую величину, присущую тому или иному случайному событию, мы вполне осознаем.

Например, если в арендуемых участках лесного фонда лесозаготовительного предприятия полностью отсутствуют насаждения березы, то получение березового фанерного кряжа следует рассматривать как невозможное событие. Увеличение потребляемой энергии на один рез при увеличении диаметров распиливаемых бревен является достоверным событием. Поломка станка в течение данной рабочей смены является случайным событием: она может быть, а может и не быть.

Случайной величиной х называется величина, которая в результате опыта может принять то или иное значение, причем неизвестно заранее - какое именно. Случайная величина содержит множество различных численных значений. Примеры случайных величин: 1) количество сучьев на дереве; 2) уменьшение (сбег) диаметра по длине ствола; 3) время цикла лесообрабатывающего станка; 4) скорость лесовозного автомобиля в каждом рейсе; 5) количество включений раскряжевочной пилы в единицу времени.

Случайные величины, принимающие только отделенные друг от друга значения, которые можно заранее перечислить, называются дискретными случайными величинами. Случайные величины, возможные значения которых непрерывно заполняют некоторый промежуток, называются непрерывными величинами.

Возможность появления случайного события характеризуется вероятностью. Вероятность события есть численная мера степени объективной возможности этого события. Часто вероятность определяют как отношение возможного числа случаев Z n при которых событие А появляется, к числу всех возможных случаев Z, то есть

P(A)=Z n /Z.

Вероятность любого события А подчинена условию 0  Р(А)

Р(А)  1, то есть вероятность случайного события – положительное число, заключенное между нулем и единицей. Иногда значения вероятностей выражаются в процентах. Чем больше вероятность события, тем чаще оно наступает. Если вероятность события очень мала, практически можно считать его появление при единичном испытании невозможным. Вероятность достоверного события равна единице, невозможного

1, то есть вероятность случайного события – положительное число, заключенное между нулем и единицей. Иногда значения вероятностей выражаются в процентах. Чем больше вероятность события, тем чаще оно наступает. Если вероятность события очень мала, практически можно считать его появление при единичном испытании невозможным. Вероятность достоверного события равна единице, невозможного  нулю. Практически невозможным называется событие, вероятность которого весьма близка к нулю. Все практическое применение теории вероятностей основывается на существовании практически достоверных и практически невозможных событий.

нулю. Практически невозможным называется событие, вероятность которого весьма близка к нулю. Все практическое применение теории вероятностей основывается на существовании практически достоверных и практически невозможных событий.

От вероятности события следует отличать его частость — относительную частоту, статистическую вероятность. Это оценка вероятности из практики по факту происшедшего, в отличие от вероятности, как теоретического понятия, определяемой из умозаключения о возможности. Если проведена серия опытов, в каждом из которых могло появиться или не появиться некоторое событие А, то частостью события А в данной серии опытов называется отношение числа опытов, в которых появилось событие А, к общему числу произведенных опытов. При небольшом числе опытов частость события носит в значительной мере случайный характер и может заметно изменяться от одной группы опытов к другой. При увеличении числа опытов относительная частота событий проявляет тенденцию к стабилизации, приближаясь с незначительными колебаниями к некоторой средней, постоянной, величине. Математическую формулировку этого свойства «устойчивости частот» впервые дал Я. Бернулли в своей теореме, которая представляет собой простейшую форму закона больших чисел. Им доказано, что при неограниченном увеличении числа однородных независимых опытов с практической достоверностью можно утверждать, что относительная частота события будет сколь угодно мало отличаться от его вероятности в отдельном опыте.

Несколько событий называются несовместными в данном опыте, если никакие два из них не могут появиться вместе. Событие А называется независимым от события В, если вероятность события А не зависит от того, произошло событие В или нет. Событие А называется зависимым от события В, если вероятность события А меняется в зависимости от того, произошло событие В или нет. Вероятность суммы двух или более несовместных событий равна сумме вероятностей этих событий – теорема сложения вероятностей. Сумма вероятностей противоположных событий равна единице. Вероятность появления двух событий равна произведению вероятности одного из них на вероятность другого, вычисленную при условии, что первое имело место. Вероятность одновременного появления независимых событий равна произведению вероятностей этих событий.

Одной из основных задач в изучении случайных величин являются не только установление возможных значений, но и оценка вероятности их появления. Методами решения этой задачи и обработки опытных данных занимается математическая статистика. Ниже дается краткое изложение основных понятий математической статистики.

Результаты наблюдений за тем или иным объектом лесозаготовок - сортименты, хлысты, пучки и плоты, автопоезда и пр., - получившие численные значения в виде случайной величины хi, называются выборкой, или выборочной совокупностью.

Пусть выборочная совокупность состоит из n однородных единиц – сортименты, хлысты и так далее. Число п является объемом совокупности, или выборки. Единицы совокупности хi, могут принимать различные численные значения, причем некоторые значения для дискретной случайной величины могут повторяться пi раз. Те величины, которые принимают одинаковые численные значения и повторяются ni раз, называют вариантами. Изменение случайной величины хi при переходе от одного варианта к другому называется вариацией, или рассеянием.

Различают, как отмечалось, дискретные и непрерывные случайные величины. Дискретной является та величина, единицы совокупности которой принимают только целочисленные значения, и измеряется она, как правило, в штуках - количество сортиментов в пачке, сучьев на дереве, валочных машин на лесосеке и так далее. Непрерывной случайной величиной называется та, единицы совокупности которой могут принимать любые непрерывные значения в выборке, и измеряется она обычно в объемных, м3, временных, массовых и других подобных единицах.

Число случаев появления (встречаемости) того или иного варианта для дискретной случайной величины называется частотой. Для непрерывной случайной величины частотой называется число случаев попадания ее в заданный интервал.

Упорядочивание вариантов случайной величины в порядке возрастания с одновременным определением частот пi для каждого значения хi приводит к построению статистического распределения выборки (ряда распределения)

х1, х2, х3,..., хi,..., хk

n1, n2, n3,.., ni, …, nk,, (2.1)

где k – количество вариантов.

Для непрерывной случайной величины строится интервальный ряд распределения посредством разбиения выборки на k не пересекающихся интервалов, границами которых служат числа x0, х1, х2, х3,..., хi,..., хk. Количество значений ni, случайной величины хi, попавшей в полуокрытый интервал (xi - 1 , xi), для которого хi-1  х< хi, называется частотой i -го интервала.

х< хi, называется частотой i -го интервала.

Отношение частоты варианта для дискретной или интервала для непрерывной случайных величин к объему выборки называется частостью.

Частость характеризует относительную частоту появления i -го варианта или относительную частоту попадания случайной величины в i -й интервал и определяется по выражению

ω i = ni/п. (2.2)

При увеличении n до бесконечности величина ω i приближается к вероятности pi.

Сумма всех частот равняется объему совокупности

n1+п2 +...+пi+...+пk =Σ ni= п. (2.3)

Сумма всех частостей равняется единице:

ω 1 + ω 2+…+ ω i+…+ ω k = Σ ω i=1 (2.4)

Дискретные ряды распределения интерпретируются графически посредством многоугольников распределения, а непрерывные – с помощью гистограмм. Подробно о способах их построения см. в [29].

Практическое представление изложенных понятий иллюстрируется на примере следующей неупорядоченной выборки. Часто данные наблюдения поступают в распоряжение исследователя в виде неупорядоченного ряда чисел. Так, время раскряжевки хi каждого последовательно поступающего хлыста на установке типа JIO-15C на лесопромышленном складе (в течение непрерывного отрезка времени смены) характеризуется следующими данными: 32, 52, 60, 54, 82, 54, 86, 77, 105, 77, 75, 107, 162, 164, 54, 50, 57, 62, 47, 82, 52, 80, 114. Число измерений (объем выборки) n = 23, а суммарная продолжительность измерений Σ xi = 1783с.

Расположение вариантов в порядке возрастания или убывания признака называется ранжированием ряда. Оно позволяет сопоставить отдельные результаты наблюдения, определить размах между наибольшим и наименьшим значениями. В рассматриваемом примере размах вариации – разность между наибольшим и наименьшим значениями – составит 164-32=132 с. Средняя арифметическая продолжительность цикла – оценка матожидания – равна частному от деления суммы всех измерений на число измерений:

t0 =Σ xi /n =1783/23=77, 5 с.

Если бы число опытов при одинаковых условиях можно было повторять до бесконечности, то, разделив сумму всех вариантов на число измерений, получили бы математическое ожидание этой величины. При увеличении числа опытов среднее значение величины стремится к ее математическому ожиданию. Среднее значение не характеризует полностью случайную величину и не дает возможности определить степень отклонения ее отдельных значений относительно среднего значения. Мерой рассеивания случайной величины является дисперсия, равная сумме квадратов отклонений значений случайной величины хi от их среднего арифметического значения (математического ожидания) t0, деленной на число измерений п. Оценка дисперсии в данном примере равна

S2=Σ (xi-t0)2/n= 25348/23=1100 с2.

Если оценка дисперсии обозначается S2, то дисперсия в теории вероятности обозначается σ 2. Аналогично обозначается среднеквадратическое отклонение – σ.

Оценка среднеквадратического отклонения (СКО) равна

S =  33, 2 с.

33, 2 с.

Относительной мерой разброса значений случайной величины является коэффициент вариации, который равен отношению среднеквадратического отклонения к среднему значению:

V=S /t0 =33, 2/77, 5=0, 428

Случайная величина будет полностью описана с вероятностной точки зрения, если задано ее распределение, т. е. указано, какой вероятностью обладает каждое из событий. Этим мы устанавливаем так называемый закон распределения случайной величины. Законом распределения случайной величины называется всякое соотношение, устанавливающее связь между значениями случайной величины и соответствующими им вероятностями. Одной из форм закона распределения является функция распределения - интегральный закон распределения, – показывающая вероятность того, что значения случайной величины меньше любого произвольного значения (числа). Функция распределения является самой универсальной характеристикой случайных величин. Она существует для всех случайных величин – как дискретных, так и непрерывных. Функция распределения является неубывающей функцией своего аргумента и существует от -  до +

до +  .

.

Вероятность нахождения значений случайной величины в каком- либо интервале равна разности между значениями функции распределения при большем и меньшем пределах аргумента (интервала). Вероятность того, что значения случайной величины будут больше какого-либо числа, равна разности между единицей и соответствующим значением функции.

Производная функции распределения называется плотностью распределения – дифференциальным законом распределения. Плотность распределения существует только для непрерывных случайных величин. Она является неотрицательной функцией. Интеграл в бесконечных пределах от плотности распределения равен единице.

Графически теоретические функции и плотность распределения непрерывных случайных величин изображаются плавными кривыми – кривые распределения, а закон и функция распределения дискретных случайных величин – в виде ломаных линий.

При большом числе наблюдений (порядка сотен) простая статистическая совокупность или вариационный ряд перестают быть удобной формой записи статистического материала. Статистический ряд непрерывной случайной величины оформляется графически в виде гистограммы. Гистограмма строится следующим образом. По оси абсцисс откладывают разряды – интервалы группирования значений случайной величины. Затем подсчитывают число измерений, значения которых находятся в данном разряде. На каждом из разрядов, как на основании, строят прямоугольник, площадь которого равна частоте данного разряда. По оси ординат откладывают частоту (вероятность). Полная площадь гистограммы равна единице.

Для предварительного определения ширины разрядов d можно использовать следующую приближенную формулу, предложенную Г.А. Стреджерсом:

d=(xmax-xmin)/(1+3, 322lg n),

где xmax-xmin – размах вариации (разность между наибольшим хтах и наименьшим xmin значениями);

n - объем выборки;

l+3, 322 lg n – число разрядов (интервалов).

При обработке опытных данных ширину разряда следует округлять до целого числа, а количество разрядов рекомендуют принимать от 10 до 20. Если середины вершин прямоугольников гистограммы последовательно соединить прямолинейными отрезками, то получим ломаную линию, называемую полигоном распределения. Для дискретных случайных величин строят полигон распределения, у которого значения ординат пропорциональны соответствующим частотам.

При необходимости анализа изменения изучаемой переменной по времени, данные располагают в хронологической последовательности. Последовательность значений какой-либо переменной, наблюдаемой на протяжении определенного периода времени, называют временным рядом. Временной ряд позволяет анализировать ритмичность производства и выполнение плана по дням, месяцам.

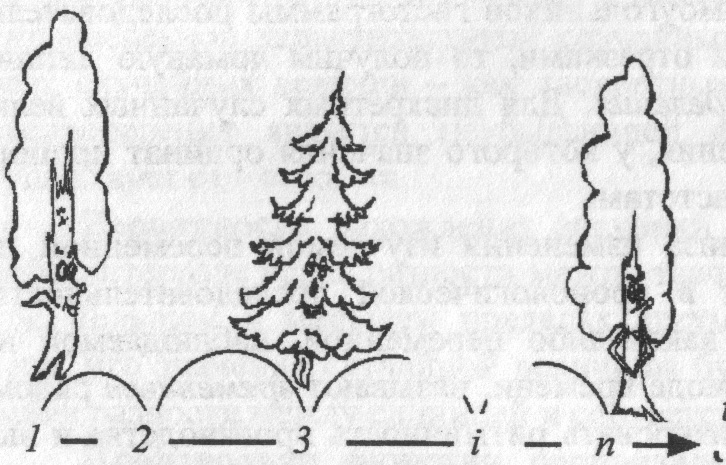

Потоки заявок (требований), поступающих на обслуживание. Они характеризуются интервалами времени (рис. 2.1), разделяющими последовательные поступления заявок на обслуживание, и распределением интервалов. В системах массового обслуживания (СМО) при описании потока заявок используются законы распределения вероятностей, а именно: распределение моментов или интервалов времени поступления заявок (требований). Эти распределения отражают либо индивидуальное (ординарное) поступление и обслуживание заявок (по одной), либо групповое (неординарное) поступление и обслуживание (в этом случае обслуживающая система называется системой с параллельно–групповым обслуживанием, например, пачковая раскряжевка). Например, ординарным потоком будет прибытие автомашин на лесосклад, неординарным будет количество деревьев, доставляемых на погрузочный пункт трелевочной машиной.

Количественно потоки также характеризуются средним числом зая- иок, поступающих в обслуживающую систему в единицу времени, это есть интенсивность поступления заявок l. Обратная величина l(1/l) является средним интервалом времени между поступлениями заявок.

Поток требований может быть регулярным (детерминированным), когда каждое требование поступает через равные промежутки времени, и нерегулярным, когда требования поступают через случайные промежутки времени. Поток может быть стационарным, когда его вероятностные характеристики (оценки матожидания и дисперсии) не зависят от времени, и нестационарным, когда поведение системы и ее вероятностные характеристики есть функция времени. Для стационарного потока характерна постоянная плотность (интенсивность) - среднее число требований в единицу времени. Например, груженые лесовозные машины, ежедневно прибы- вающие на лесопромышленный склад в течение зимнего периода, можно рассматривать как стационарный поток. Однако в течение года интенсивность вывозки автомашинами меняется, и для годового периода этот поток будет нестационарным.

Поток может быть без последействия, то есть с отсутствием памяти, когда требования появляются в последовательные моменты времени независимо друг от друга. Поток событий (заявок), являющийся стационарным, ординарным с отсутствием последействия, называется простейшим, или пуассоновским, потоком.

Поступающий поток характеризуется также емкостью источника, который его создает. Емкость источника, генерирующего заявки на обслуживание, может быть ограниченна – количество заявок на ремонт не может быть больше количества машин и неограниченна – деревья, поступающие в рубку в условиях неистощенной лесосырьевой базы.

Более подробно о потоках лесопромышленных объектов и их характеристиках можно прочесть в [3, 13, 15].

Распределение вероятностей случайных величин. Для оценки вероятности появления той или иной случайной величины используются описывающие их законы распределения. Наиболее часто встречаются следующие распределения вероятностей дискретных случайных величин: биноминальное, гипергеометрическое, пуассоновское.

Биноминальное распределение вероятностей описывает появление событий, имеющих два противоположных исхода. Например, этими исходами может быть количество исправных и находящихся в ремонте трелевочных тракторов, лесовозных автомобилей, бензо- и электропил. Если вероятность события постоянна и равна р, то вероятность того, что это событие произойдет точно т раз в п повторяющихся испытаниях – закон распределения, – равна

pm =  pm(1-p)n-m=

pm(1-p)n-m=  т (1-р) n-т, (2.6)

т (1-р) n-т, (2.6)

где  – число сочетаний из п по m; m!, n! – факториалы чисел m, n;

– число сочетаний из п по m; m!, n! – факториалы чисел m, n;

n! =1*2*3*…*(n-1)*n.

|

| Рис. 2.1. Графическая интерпретация потока заявок в течение времени |

Биноминальное распределение имеет два параметра (характеристики распределения) р и п. Математическое ожидание – среднее значение – случайной величины, распределяемой по биноминальному закону, равно пр, а дисперсия равна (l- p) np.

Гипергеометрическое распределение получается при следующих условиях. Допустим, что в общем объеме совокупности, состоящей из N предметов, М предметов обладают нужным признаком, а (N-M) этим признаком не обладают. Если из общего объема выбрать наугад п предметов, то вероятность того, что m предметов среди выбранных обладают нужным свойством, а остальные (п-т) им не обладают, определится по формуле

pn =

/

/  (2.7)

(2.7)

Это распределение отличается от биноминального тем, что изъятый объект обратно в совокупность не возвращают. Гипергеометрическое распределение характеризуется тремя параметрами: 1) объемом совокупности N; 2) объемом выборки п и 3) вероятностью того, что первый отобранный предмет будет иметь нужный признак, M/N.

Математическое ожидание случайной величины, характеризуемой гипергеометрическим распределением, равно nM/N, а дисперсия равна

M(N-M)  (2.8)

(2.8)

Одним из наиболее распространенных законов распределения вероятностей дискретных случайных величин является закон Пуассона. Вероятность того, что случайная величина mх примет значение z = О, 1, 2, 3,..., определяется формулой

Pz=e-a  (2.9)

(2.9)

где е  2, 7183 - основание натуральных логарифмов;

2, 7183 - основание натуральных логарифмов;

а -среднее число событий за данный постоянный интервал времени t;

z! - факториал числа z, z! = l*2*3*...*(z– 1) z, a = l t, где l- интенсивность появления событий – среднее количество событий, появляющихся в единицу времени. Вероятность того, что событие за время t не наступит (mх = 0), равна e-a.

Закон Пуассона имеет только один параметр а. Математическое ожидание и дисперсия случайной величины, имеющей пуассоновское распределение, равны между собой и равны параметру а. Это равенство среднего значения и дисперсии часто рассматривается как свидетельство или, по крайней мере, как некоторое указание на то, что распределение анализируемой случайной величины следует закону Пуассона. Этот закон является предельным. К нему приближаются распределения многих дискретных случайных величин (потоков) при условии более или менее равномерного воздействия на них большого числа случайных факторов.

В лесозаготовительных процессах чаще могут встречаться следующие основные виды распределения непрерывных величин: показательное (экспоненциальное), нормальное, усеченное нормальное, эрланговское, равномерное, размаха.

Показательным законом описывается распределение случайных интервалов времени между наступлением событий, подчиняющихся закону распределения Пуассона. Утверждения о том, что распределение длительности интервалов времени между последовательным появлением событий является показательным (экспоненциальным) или что распределение числа событий за одинаковые интервалы подчиняется закону Пуассона, равносильны. Вероятность того, что значения случайной величины, имеющей показательное распределение, будут меньше t (функция распределения), равна P(t)=1–e-lt. (2.10)

Плотность показательного распределения

P(t)=le–lt . (2.11)

Обозначения величин расшифрованы ранее. Математическое ожида- ние и среднеквадратическое отклонение равны между собой и равны 1/l. Если промежуток времени, распределенный по показательному закону, уже длился некоторое время, то это никак не влияет на закон распределения оставшейся части промежутка: он также будет показательным.

Распределение Эрланга связано с пуассоновским распределением и получается преобразованием последнего. Если пользоваться терминологией теории массового обслуживания, то можно констатировать, что поток Эрланга получается путем особого преобразования (разрежения) стационарного пуассоновского (простейшего) потока, заключающегося в выбра- сывании некоторых событий из простейшего потока.

Потоком Эрланга К -то порядка называется поток, полученный из простейшего, если сохранить каждое (К +1)-е событие, а остальные исключить. В свою очередь простейший поток можно рассматривать как поток Эрланга нулевого порядка. Функция эрланговского распределения будет иметь вид

(2.12)

(2.12)

Плотность распределения равна

pk(t)=l(l t)Кe–lt/ К! (2.13)

где К = О, 1, 2, 3,... – порядок распределения Эрланга;

l – интенсивность исходного простейшего (пуассоновского) потока; t - интервал времени; е - основание натуральных логарифмов; п - переменная величина, п = О, 1, 2, 3,..., К.

Математическое ожидание случайной величины, распределенной по закону Эрланга, равно (К+1)/l, а дисперсия (К+1)/l 2.

При неограниченном увеличении К нормированный поток Эрланга приближается к регулярному потоку с постоянными интервалами между заявками, равными 1/l.

Нормальное распределение, распределение Гаусса – Лапласа, встречается в практике наиболее часто. Этот закон является предельным, к которому приближаются другие законы распределения при наличии определенных условий. Сумма достаточно большого числа независимых (или слабо зависимых) случайных величин, подчиненных каким угодно законам распределения, приближенно подчиняется нормальному закону, и это правило выполняется тем точнее, чем большее количество случайных величин суммируется.

Плотность распределения случайной величины х, соответствующая нормальному закону, равна

Функция распределения равна

Здесь среднее квадратическое отклонение σ и математическое ожидание V являются параметрами распределения;

Ф  и

и  - нормированные интегральная и дифференциальная функции Лапласа; π = 3, 141...; е = 2, 7183.

- нормированные интегральная и дифференциальная функции Лапласа; π = 3, 141...; е = 2, 7183.

При любых значениях σ и V площадь, ограниченная кривой распределения и осью абсцисс, равна единице. Кривая нормального распределении имеет холмообразный симметричный вид. Если σ оставить постоянной, а V изменить, то кривая распределения сместится вдоль оси абсцисс, не изменяя своего вида. При малых значениях σ кривая нормального распределения принимает иглообразный вид, а при больших становится плосковершинной. В пределах V ±σ находится 68, 3 % всех значений случайной величины, подчиняющейся нормальному распределению; в пределах V ±2 σ и V ±3 σ - соответственно, 95, 4 и 99, 7 %. Пределы значений случайной величины могут быть от –  до +

до +

Усеченное нормальное распределение получается, если значения случайной величины будут ограничены справа или слева каким-то пределом С – точкой усечения. Плотность односторонне усеченного нормального распределения

p(x) =  (2.16)

(2.16)

Функция такого распределения равна

Р (х)=  (2.17)

(2.17)

Параметры распределения – математическое ожидание V и среднее квадратическое отклонение σ – определяются с помощью специальных функций.

Равномерное распределение вероятностей характеризует непрерывные случайные величины, все возможные значения которых лежат в пределах определенного интервала, причем в этих пределах плотность вероятности их постоянна. Плотность распределения равна

р(х) =  при а

при а  х

х  < b;

< b;

р(х) = 0 при а > х > b. (2.18)

О 2 4 6 8 10 X

Рис. 2.2. Плотности различных законов распределения случайных величин: а - непрерывных; б - дискретных

Функция распределения равна:

Р(х) =  при а

при а  х

х

Р(х) = 0 при х < а:

Р(х) = 1 при х  b - (2.19)

b - (2.19)

а и b - нижний и верхний пределы значений случайной величины. Математическое ожидание равно (а +b)/2, а дисперсия (b - a)2/12.

Другие распределения непрерывных случайных величин (см. рис. 2.2) будут пояснены при решении конкретных задач.

Многие практические задачи связаны с нахождением закона распределения суммы независимых случайных величин по известным законам распределения слагаемых, то есть с композицией распределений. Если имеются две независимые случайные величины х и у с плотностями распределений, соответственно, p1 (х) и p 2(у), то плотность распределения их суммы z=x+у определяется следующим законом композиции:

p(z)=  (x) p 2(z-x) dx. (2.20)

(x) p 2(z-x) dx. (2.20)

При композиции двух или более независимых случайных величин, подчиненных нормальному закону распределения, также получается нормальный закон. Конечное распределение будет иметь дисперсию и математическое ожидание, равные, соответственно, суммам этих величин исходных распределений. Из наиболее распространенных распределений вероятностей, кроме распределения Гаусса, только распределение Пуассона обладает аналогичным свойством.

Композиция двух независимых показательных распределений с одинаковыми параметрами и плотностями, равными p1(x)=le–lx и р2(у)=l e—ly дает для z = х + у плотность p(z) = z l2 e-l z. (2.21)

При необходимости определить распределение суммы большего количества случайных величин при известных законах их распределения следует прибегнуть к методу последовательной их композиции.

|

|