Главная страница Случайная страница

Разделы сайта

АвтомобилиАстрономияБиологияГеографияДом и садДругие языкиДругоеИнформатикаИсторияКультураЛитератураЛогикаМатематикаМедицинаМеталлургияМеханикаОбразованиеОхрана трудаПедагогикаПолитикаПравоПсихологияРелигияРиторикаСоциологияСпортСтроительствоТехнологияТуризмФизикаФилософияФинансыХимияЧерчениеЭкологияЭкономикаЭлектроника

Метод наименьших квадратов

|

|

Лабораторная работа № 3

Тема: Регрессионный анализ

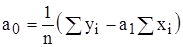

Уравнение линейной парной регрессии

Уравнение линейной парной регрессии выглядит следующим образом: Y=a0+а1X При помощи этого уравнения переменная Y выражается через константу a0 и угол наклона прямой (или угловой коэффициент) а1, умноженный на значение переменной X. Константу a0 также называют свободным членом, а угловой коэффициент - коэффициентом регрессии. Параметры уравнения могут быть определены с помощью метода наименьших квадратов (МНК)

Метод наименьших квадратов

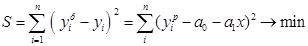

(в справочных системах англоязычных программ - Least Squares Мethod, LS) является одним из основных методов определения параметров регрессионных уравнений, дающий наилучшие линейные несмещенные оценки. Именно он используется в MS Excel. Линейные – относится к характеру взаимосвязи переменных. Несмещенные значит, что ожидаемые значения коэффициентов регрессии должны быть истинными коэффициентами. То есть точки, построенные по исходным данным  , должны лежать как можно ближе к точкам линии регрессии. Сущность данного метода заключается в нахождении параметров модели, при которых сумма квадратов отклонений эмпирических (фактических) значений результирующего признака от теоретических, полученных по выбранному уравнению регрессии, то есть:

, должны лежать как можно ближе к точкам линии регрессии. Сущность данного метода заключается в нахождении параметров модели, при которых сумма квадратов отклонений эмпирических (фактических) значений результирующего признака от теоретических, полученных по выбранному уравнению регрессии, то есть:

,

,

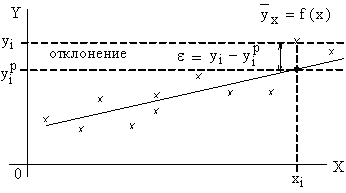

где  – значение, вычисленное по уравнению регрессии;

– значение, вычисленное по уравнению регрессии;  – отклонение

– отклонение  (ошибка, остаток) (рис. 1); n – количество пар исходных данных.

(ошибка, остаток) (рис. 1); n – количество пар исходных данных.

Рис. 1 Понятие отклонения  для случая линейной регрессии

для случая линейной регрессии

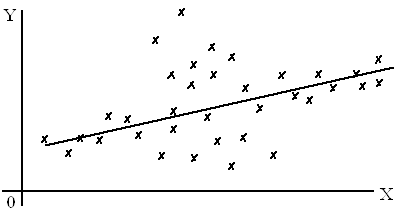

В регрессионном анализе предполагается, что математическое ожидание случайной величины  равно нулю и ее дисперсия одинакова для всех наблюдаемых значений Y. Отсюда следует, что рассеяние данных возле линии регрессии должно быть одинаково при всех значениях параметра X. В случае, показанном на рис. 2 данные распределяются вдоль линии регрессии неравномерно, поэтому метод наименьших квадратов в этом случае неприменим.

равно нулю и ее дисперсия одинакова для всех наблюдаемых значений Y. Отсюда следует, что рассеяние данных возле линии регрессии должно быть одинаково при всех значениях параметра X. В случае, показанном на рис. 2 данные распределяются вдоль линии регрессии неравномерно, поэтому метод наименьших квадратов в этом случае неприменим.

Рис.2. Неравномерное распределение исходных точек вдоль линии регрессии

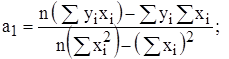

Проведя необходимые преобразования, получим систему двух уравнений с двумя неизвестными а0 и а1, которые найдем решив систему.

(1)

(1)

(2)

(2)

Направление связи между переменными определяется на основании знаков (отрицательный или положительный) коэффициента регрессии (коэффициента а1).

Если знак при коэффициенте регрессии - положительный, связь зависимой переменной с независимой будет положительной. В нашем случае знак коэффициента регрессии положительный, следовательно, связь также является положительной.

Если знак при коэффициенте регрессии - отрицательный, связь зависимой переменной с независимой является отрицательной (обратной).

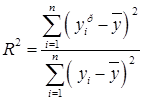

Для анализа общего качества уравнения уравнения регрессии используют обычно множественный коэффициент детерминации R2, называемый также квадратом коэффициента множественной корреляции R. R2 (мера определенности) всегда находится в пределах интервала [0; 1].

Если значение R2 близко к единице, это означает, что построенная модель объясняет почти всю изменчивость соответствующих переменных. И наоборот, значение R-квадрата, близкое к нулю, означает плохое качество построенной модели.

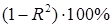

Коэффициент детерминации R2 показывает, на сколько процентов ( ) найденная функция регрессии описывает связь между исходными значениями факторов X и Y

) найденная функция регрессии описывает связь между исходными значениями факторов X и Y

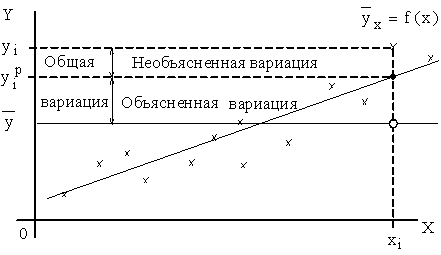

где  – объясненная вариация;

– объясненная вариация;  – общая вариация (рис.3).

– общая вариация (рис.3).

Рис. 3 Графическая интерпретация коэффициента детерминации для случая линейной регрессии

Соответственно, величина  показывает, сколько процентов вариации параметра Y обусловлены факторами, не включенными в регрессионную модель. При высоком (

показывает, сколько процентов вариации параметра Y обусловлены факторами, не включенными в регрессионную модель. При высоком ( ) значении коэффициента детерминации можно делать прогноз

) значении коэффициента детерминации можно делать прогноз  для конкретного значения

для конкретного значения  .

.

|

|